Почему искусственный интеллект Deepfakes должен напугать вас живых Bejeezus

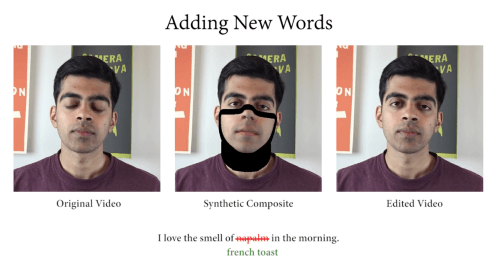

Новое программное обеспечение позволяет вам изменять, редактировать и удалять слова, исходящие изо рта человека, на видео, просто набирая текст. YouTube / Охад Фрид

Я знаю, о чем вы думаете: я надеюсь, что когда-нибудь появится действительно пугающий и простой способ создания фальшивых видеороликов и дезинформации, при котором люди, похоже, говорят слова, которые никогда не изначально сказал.

Будьте уверены, этот антиутопический кошмар Филипа К. Дика… теперь стал реальностью.

Подпишитесь на бизнес-бюллетень Observer

Ученые из Стэнфордского университета, Институт информатики Макса Планка, Принстонский университет и Adobe Research разработали программное обеспечение, которое позволит вам редактировать и изменять то, что люди говорят в видеороликах, и создавать реалистичные фейки.

Ура.

Рад, что это никогда не попадет в чужие руки и не вызовет серьезных международных инцидентов.

Как раз тогда, когда жизнь не была достаточно удовлетворительной, чтобы люди ловили сомиков через Tinder или Twitter, сейчас есть программное обеспечение, которое использует машинное обучение и 3D-модели лица цели для создания новых материалов, которые позволяют изменять, редактировать и удалять слова comi изо рта человека на видео - просто набрав текст. И эти изменения, кажется, имеют цельный аудиовизуальный поток без скачкообразных переходов.

Я мог бы точно рассказать, как работает технология программного обеспечения, но есть видео, которое делает все это за меня.

Как я уже упоминал, уже существует неограниченное количество идей, которые могут использовать эту технологию в злых целях. Давайте держать это подальше от любых суперзлодеев. Верно?

Помните, как сумасшедшие были на той неделе, когда кто-то отредактировал видео с Нэнси Пелоси, чтобы она выглядела пьяной? А теперь представьте, если бы кто-то использовал это программное обеспечение, чтобы создать впечатление, будто Нэнси Пелоси ругается, как пьяный моряк, или извергает расистскую риторику, а затем это видео просачивается в мир.

Или представьте себе после митинг сторонников превосходства белых в Шарлоттсвилле, объедините правых, если бы кто-то снял кадры с Трампом и манипулировал ими, чтобы создать впечатление, будто он говорил, что с обеих сторон есть «очень хорошие люди…» Ой, подождите, он действительно сказал это… неважно.

Похоже, что программа deepfake для русской фермы троллей эквивалентна приближающемуся Рождеству - теперь, когда начался сезон выборов 2020 года. У нас уже есть порноместь в мире; только представьте, какие слова брошенный любовник мог бы вложить в рот своему бывшему, прежде чем отправить дипфейк-видео членам семьи бывшего. Ух.

Поскольку компания Adobe Research участвует в процессе разработки, я уверен, что пройдет всего несколько лет, прежде чем мы увидим, как этот инструмент дипфейка появится в последнем обновлении программного обеспечения Adobe для редактирования видео Premiere Pro. Как это могло пойти не так?

Сайт исследования программного обеспечения заполнен огромными отказами от ответственности и параграфами по этическим соображениям:

Мы также считаем важным получить разрешение от исполнителей на любые изменения перед тем, как поделиться полученным видео с широкой аудиторией.

И…

Мы признаем, что злоумышленники могут использовать такие технологии для фальсификации личных заявлений и клеветы на известных людей. Мы обеспокоены подобным обманом и злоупотреблениями.

Кажется, что повсюду появляется все больше и больше дипфейков. Два художника, Билл Постерс и Дэниел Хоу, совместно с рекламной компанией Canny создали видео, на котором Марк Цукерберг сидит за столом и произносит зловещую речь о мощи Facebook.

«Представьте себе это…» (2019). Работа с движущимися изображениями deepfake из серии «Big Dada», часть проекта «Spectre». Сочетание больших данных, искусственного интеллекта, дадаизма и концептуального искусства. . Работы Билла Постерса и @danyelhau #spectreknows #privacy #democracy #surveillancecapitalism #dataism #deepfake #deepfakes #con Contemporaryartwork #digitalart #generativeart #newmediaart #codeart #markzuckerberg #artivism #con Contemporaryart

Автор: Billp> Плакаты (@bill_posters_uk) 7 июня 2019 г. в 7:15 по тихоокеанскому времениDeepfake Zuck был создан с использованием технологии замены видеодиалога (VDR) CannyAI и сопоставлен с видео Цукерберга, выступившим в сентябре 2017 г., с обращением к выборам в России. вмешательство в Facebook. Видео было опубликовано, чтобы проверить политику модерации контента в Facebook.

Джо Роган также подвергся дипфейке от компании Dessa, занимающейся искусственным интеллектом, которая недавно выпустила звук, который отчетливо звучит так, как будто подкастер рассказывает о хоккее с шимпанзе.

Хорошо, что это будет использоваться только во благо, верно? Никакие «плохие актеры» никогда не использовали программное обеспечение для плохих целей.

Лучший сценарий: отличный инструмент для исправления сбоев в пост-продакшн при создании документаЭлементарно и для создания забавных снимков.

Худший сценарий: Третья мировая война

комментариев